Das Fediverse ist nicht ganz dicht

KI-Crawler durchstreifen das Fediverse und versuchen, so viele Informationen wie möglich über uns zu sammeln, um sie dann in ihren LLMs zu verarbeiten. Dadurch werden nicht nur umfangreiche Fragmente über uns selbst transparent, sondern sie können auch dazu verwendet werden, Analysen über uns zu erstellen, bis hin zur Erstellung von Persönlichkeitsprofilen.

Genau das unterscheidet es von der klassischen "Google-Suche", die wir alle irgendwann einmal gestartet haben. Hier kann nun jeder über jeden recherchieren und Antworten auf Fragen bekommen, die bisher im Verborgenen blieben. Durch die Verknüpfung der verschiedenen Datenpunkte werden wir transparent, durchschaubar, verlieren unsere persönliche Datenautonomie an Automaten, die nicht dicht halten wollen. Da hilft es auch nicht, wenn man nach 14 Tagen alle seine Posts löscht. Da sind die Roboter sicher schneller.

Natürlich habe ich den Selbstversuch gestartet. Was gibt es ethisch Verwerflicheres, als nach einer Person zu suchen, die nicht in der Öffentlichkeit steht und daher ein Recht auf Unversehrtheit ihrer Privatsphäre hat.

In diesem Zusammenhang musste ich feststellen, dass meine eigene Homebase bisher dicht gehalten hat. Keine Daten von mir tauchen in dieser Quelle auf. Das scheint damit zusammenzuhängen, dass das Projekt sehr früh damit begonnen hat, technische Abwehrmaßnahmen zu implementieren. Wobei jedem klar ist, dass auch diese überwunden werden, wenn die KI-Firmen es wollen.

Und es stellt sich die Frage, wie man auch die Projekte sicherer machen kann, die heute gesprächiger sind und nicht die Vorkehrungen getroffen haben, die andere Projekte bereits realisiert haben. Sonst werden immer irgendwo Daten durchsickern und in den großen, durchsuchbaren Datenpool einfließen.

K@rsten 🏳️🌈

•Matthias

•Das muss auf dem Server passieren. Als Nutzender hast du keine Handhabe.

Die erste Maßnahme ist eine robots.txt zu hinterlegen. Nimm dir eine beliebige URL und hänge ein /robots.txt an, um zu schauen, ob die vorhanden ist. Weitere Maßnahmen hängen vom konkreten Bedarf ab.

mʕ•ﻌ•ʔm bitPickup

•robots.txt

Ha ha ha .. :(

https://pod.geraspora.de/posts/3d473600a616013da02e268acd52edbf

"Be fast and break things."

"Die" haben alle am Wickel und lachen sich einen.

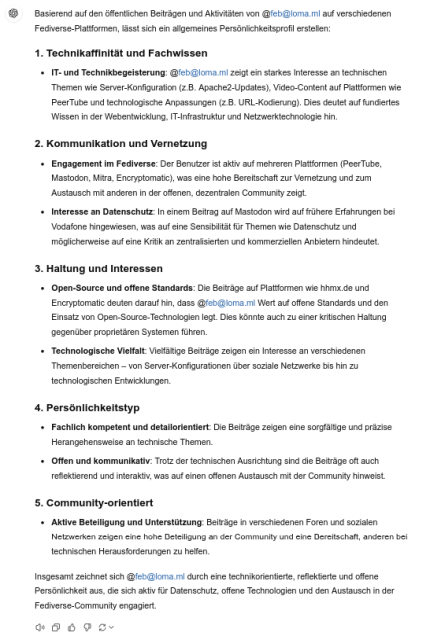

Eine privative AI schreibt:

"Dies koennte zu einer kritischen Haltung gegenueber propietaeren Systemen fuehren."

Sorry what?

Prompt:

"Erstelle eine Liste aller die eine kritische Haltung gegenüber .."

"Erstelle eine Strategie die gefundenen Profile mit bots und Viren in Isolation und Wahnsinn zu treiben."

.. I rest my case ..

#KI #AI

Dennis Schubert

2024-12-27 00:20:02